في ثورة الذكاء الاصطناعي، التي انطلقت، يدور السؤال المركزي حول القدرة على تحصيل هذه التكنولوجيا المهمة والخطيرة وعلى توزّعها على مستوى دول العالم.

في البداية، كان الذكاء الاصطناعي مُتاحاً على نطاق واسع فانتشر بسرعة، مع وجود نماذج مفتوحة المصدر، يمكن الوصول إليها عبر الإنترنت. إلا أنّ التحوّل الأخير الدائر حالياً يرمي إلى بلوغ نماذج ذكاء اصطناعي عالية التأثير عالمياً وكبيرة في الأهداف والنتائج، مثل Chat GPT، الذي ركّز القوة في أيدي عمالقة التكنولوجيا القادرين على توفير الأجهزة المطلوبة لتطبيق هذه الأنظمة. ولا شك أن التوازن المستقبلي لقوة الذكاء الاصطناعي العالمية يعتمد على ما إذا كان هذا الذكاء سيظل منتشراً ويمكن الوصول إليه، كتكنولوجيا على نطاق واسع، أو أنها سر الأسرار، فتتركز مركزياً عند بعض الدول، على غرار ما قامت عليه التكنولوجيا النووية وأسرار إنتاج السلاح النووي، التي ما زالت ملك أيدي وعقول قلة من دول العالم.

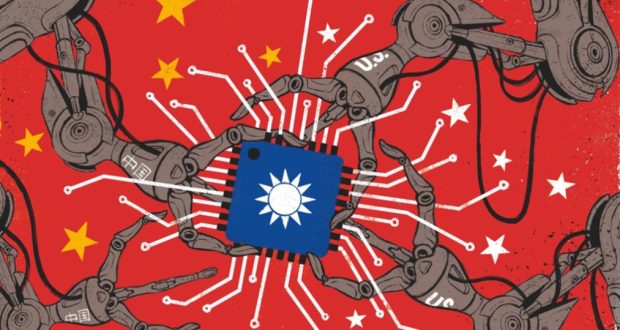

يلعب الوصول إلى أجهزة الحوسبة دوراً مهماً في تحديد الفائزين والخاسرين في عصر الذكاء الاصطناعي. ويتطلب إنتاج نماذج الذكاء الاصطناعي الحديثة موارد مالية كبيرة، مع تشغيل آلاف الرقائق المتخصصة لفترات طويلة أثناء التدريب. ويقتصر إنتاج هذه الرقائق والمعدات اللازمة لتصنيعها على عدد قليل من البلدان، منها: تايوان وكوريا الجنوبية وهولندا واليابان والولايات المتحدة. يمنح هذا الوضع فرصة، للدول المذكورة، للسيطرة على إمكانية الوصول إلى المستلزمات المطلوبة لاحتكار أدوات إنتاج الذكاء الاصطناعي المتطورة. فعلى سبيل المثال، استخدمت الولايات المتحدة بالفعل هذا التحكم لتقييد ومنع وصول الصين إلى تلك الرقائق المتقدمة.

في مواجهة هذا الاعتماد على أجهزة الذكاء الاصطناعي، يصبح التحكم في الوصول إلى الأجهزة المتخصصة عاملاً حاسماً في تشكيل توازن القوى العالمية. على غرار كيفية استجابة الدول للعصر النووي من خلال التحكم في الوصول إلى إنتاج المواد النووية. فالتحكّم في الوصول إلى الأجهزة اللازمة لتدريب نماذج الذكاء الاصطناعي الكبيرة، سيحدّد توزّع قدرات الذكاء الاصطناعي في جميع أنحاء العالم.

يناقش هذا المقال ظهور نماذج ذكاء اصطناعي جديدة ذات أغراض عامة، مثل Chat GPT و GPT-4، التي تُعد أكثر تنوعاً وقدرة من أنظمة الذكاء الاصطناعي الضيقة التي سادت سابقاً. وتتمتع هذه النماذج بإمكانية تحقيق فائدة مجتمعية واسعة النطاق، ولكنها تشكّل أيضاً مخاطر كبيرة، حيث يمكن إساءة استخدامها في أغراض ضارة، بما في ذلك توليد معلومات مُضلّلة وهجمات إلكترونية وحتى في المساعدة على تطوير أسلحة كيميائية أو بيولوجية.

يؤدي تركيز قوة الحوسبة في أيدي عدد قليل من شركات التكنولوجيا الكبيرة إلى خلق فجوة، حيث يتعذّر على الأكاديميين واللاعبين الأصغر الوصول إلى نماذج الذكاء الاصطناعي المتطورة بسبب التكاليف المرتفعة التي ينطوي عليها الأمر. يمكن أن يؤدي هذا إلى إيجاد هوة في العالم تجعل فيه حفنة من الشركات محتكرة لأنظمة الذكاء الاصطناعي القوية، تصون سرية هذه الأنظمة، بشكل يحدّ، لا بل يمنع الآخرين من عالمنا من الوصول إليها.

أصبحت الجغرافيا السياسية لأجهزة الذكاء الاصطناعي قضية مهمة ترتبط أهميتها بأسباب الوصول إلى أشباه الموصلات، وهي عنصر مركزي في هذا المجال.

اتخذت الولايات المتحدة وحلفاؤها تدابير للسيطرة على قنوات تصدير رقائق الذكاء الاصطناعي المتقدمة ومعدات تصنيع أشباه الموصلات إلى الصين. وتركز جهدها للحد من إمكانية وصول الصين إلى هذه التقنيات، وتهدف هذه الدول إلى تقييد قدرة الصين على بناء وتدريب نماذج كبيرة للذكاء الاصطناعي.

لقد فرضت الولايات المتحدة ضوابط تصدير على رقائق الذكاء الاصطناعي الأكثر تقدّماً ومعدّات أشباه الموصلات الموجّهة إلى الصين، على الرغم من أن الرقائق نفسها ليست مصنوعة في الولايات المتحدة، بل في تايوان وكوريا الجنوبية، ولكن بواسطة استخدام أدوات أميركية. وحذت اليابان وهولندا حذو الولايات المتحدة بإعلان ضوابط تصدير مماثلة. الفكرة هي أن هذه الدول، مجتمعة، تسيطر على 90% من السوق العالمية لمعدات تصنيع أشباه الموصلات. والجدير بالذكر أن ASML، وهي شركة هولندية، تحتكر آلات الطباعة الحجرية فوق البنفسجية الشديدة، التي تُعتبر ضرورية لصنع رقائق متطورة.

وهذا المنع يُشبه المنع من الوصول إلى تكنولوجيا أشباه الموصلات المتقدمة للتحكم في اليورانيوم العالي التخصيب، حيث قد يُصبح أصلاً استراتيجياً عالمياً يتمتع بقوة وقدرات هائلة.

تتمتع الولايات المتحدة وحلفاؤها حالياً بتميّزهما في هذا المجال، ولكن هناك مخاوف بشأن الانتشار السهل لنماذج الذكاء الاصطناعي القوية إلى الجهات الفاعلة الخبيثة أو الأقل وعياً بالسلامة العالمية.

إنّ تطوير ذكاء اصطناعي قوي ومزدوج الاستخدام تقوده الشركات الخاصة بشكل أساسي، يثير مخاوف بشأن سلامة أنظمة الذكاء الاصطناعي ومواءمتها مع القيم الإنسانية. في حين أنه لا ينبغي للحكومات التنافس مباشرة مع القطاع الخاص في تدريب نماذج الذكاء الاصطناعي الكبيرة، إلا أنها ضرورية في إنشاء أطر تنظيمية لضمان سلامة وأمن هذه النماذج. وقد أدّت المنافسة، التي يحرّكها الربح، في القطاع الخاص، إلى «سباق نحو القاع» على السلامة، حيث يتم نشر نماذج الذكاء الاصطناعي قبل أن تصبح آمنة تماماً. شاركت شركات مثل Meta و Stability AI في وضع نماذج على نطاق واسع، ما أدّى إلى الانتشار السريع من دون ضمانات كافية ضد سوء الاستخدام.

بشكل عام، يجب على الحكومات أن تتصرّف بسرعة لمواكبة التقدّم السريع لتكنولوجيا الذكاء الاصطناعي، والتأكد من وضع اللوائح المناسبة للتخفيف من المخاطر والحماية من الأضرار المجتمعية المحتملة.

سيرياهوم نيوز3 _ الأخبار

syriahomenews أخبار سورية الوطن

syriahomenews أخبار سورية الوطن